Hirdetés

Az elmúlt néhány hónapban valószínűleg elolvasta a környéket egy cikk, amelynek szerzője Stephen Hawking, megvitatja a mesterséges intelligencia kockázatait. A cikk szerint az AI súlyos veszélyt jelenthet az emberiségre. Hawking nincs ott egyedül - Elon Musk és Peter Thiel mindketten szellemi közszereplők, akik hasonló aggodalmaikat fejezték ki (Thiel több mint 1,3 millió dollárt fektetett be a kérdés és a lehetséges megoldások kutatására).

A Hawking cikk és Musk megjegyzései egy kissé vidám jellegűek voltak, hogy ne tegyünk rá túl finoman egy pontot. A hang nagyon kedves volt "Nézd meg ezt a furcsa dolgot, amelyet ezek a geek aggódnak." Kis figyelmet fordít az a gondolat, hogy ha a Föld egyik legokosabb embere figyelmezteti Önt, hogy valami nagyon veszélyes lehet, akkor érdemes meghallgatni.

Ez érthető - a mesterséges intelligencia, amely átveszi a világot, minden bizonnyal nagyon furcsa és hihetetlen, talán azért, mert ezt a gondolatot már a tudományos fantasztikus művek már óriási figyelmet fordítják írók. Szóval, mit szóltak ezek a névlegesen ésszerű, ésszerű emberek?

Mi az intelligencia?

A mesterséges intelligencia veszélyéről való beszélgetéshez hasznos lehet megérteni, mi az intelligencia. A probléma jobb megértése érdekében vessünk egy pillantást egy játék AI architektúrájára, amelyet az érvelés elméletét kutató kutatók használnak. Ezt a játék AI-t AIXI-nek hívják, és számos hasznos tulajdonsággal rendelkezik. A célok tetszőlegesek lehetnek, jól illeszkednek a számítási teljesítményhez, belső kialakítása nagyon tiszta és egyértelmű.

Ezenkívül az építészet egyszerű, praktikus verzióit is megvalósíthatja, amelyek többek között megtehetik játszani Pacman, ha akarod. Az AIXI egy Marcus Hutter nevű AI kutató terméke, aki vitathatatlanul az algoritmikus intelligencia legelső szakértője. Erről beszél a fenti videó.

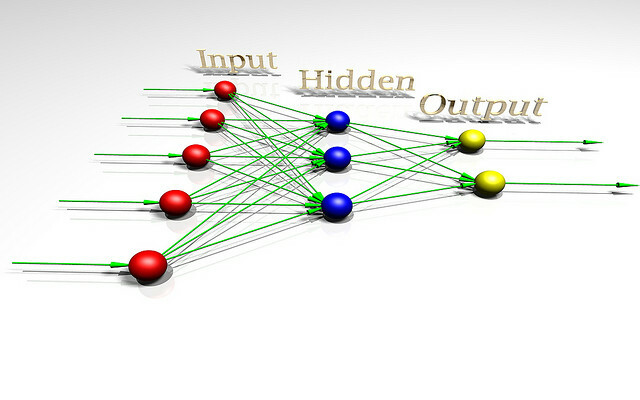

Az AIXI meglepően egyszerű: három alapvető elemmel rendelkezik: tanuló, tervezőés hasznossági függvény.

- Az tanuló bites sorokat vesz, amelyek megfelelnek a külvilággal kapcsolatos bemeneteknek, és számítógépes programokon keresztül keresi, amíg meg nem találja azokat, amelyek megfigyeléseket produkálnak outputként. Ezek a programok együttesen lehetővé teszik, hogy kitalálásokat készítsen arról, hogy néz ki a jövő, egyszerűen az egyes programok futtatásával a program előrehaladása és az eredmény valószínűségének súlyozása a program hosszával (az Occam program megvalósítása) Borotva).

- Az tervező megkeresi az ügynök által elvégzendő lehetséges műveleteket, és a tanuló modul segítségével megjósolja, mi történne, ha mindegyiküket megteszi. Ezután besorolja őket az előrejelzett eredmények jó vagy rossz szempontjából, és kiválasztja a folyamatot olyan intézkedés, amely maximalizálja a várt eredmény jóságát, szorozva a várt valószínűséggel elérni.

- Az utolsó modul, a hasznossági függvény, egy egyszerű program, amely leírja a világ jövőbeli állapotát, és kiszámítja egy hasznossági pontszámot. Ez a hasznossági pontszám mennyire jó vagy rossz az eredmény, és a tervező ezt használja a jövőbeli világállapot értékeléséhez. A segédfunkció tetszőleges lehet.

- Összességében ez a három elem alkot egy optimalizáló, amely egy adott célra optimalizálódik, függetlenül attól, hogy melyik világon találja magát.

Ez az egyszerű modell az intelligens ügynök alapvető meghatározását képviseli. Az ügynök megvizsgálja a környezetet, felépíti annak modelljeit, majd e modellek segítségével megkeresi azt a cselekvési útvonalat, amely maximalizálja az esélyét, hogy megszerezze azt, amit akar. Az AIXI szerkezete hasonló az AI-hez, amely sakkot játszik, vagy más, ismert szabályokkal játszó játékokat - azzal a különbséggel, hogy a játékszabályok alapján le tudja következtetni a játék szabályait, nulla ismeretektől kezdve.

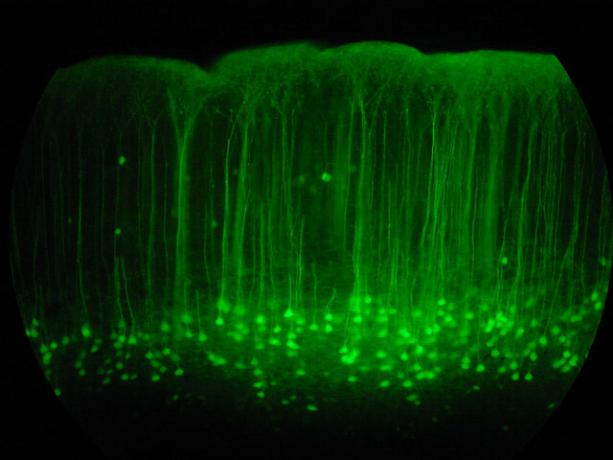

Az AIXI, mivel elegendő idő van a számításhoz, megtanulhatja bármilyen rendszer optimalizálását bármilyen cél elérésére, bármennyire bonyolult is. Ez általában intelligens algoritmus. Vegye figyelembe, hogy ez nem ugyanaz, mint az emberhez hasonló intelligencia (a biológiailag ihletett AI egy egészen más téma Giovanni Idili, az OpenWorm: Agyok, férgek és mesterséges intelligenciaAz emberi agy szimulálása jó út, de a nyílt forráskódú projekt létfontosságú első lépéseket tesz a tudomány által ismert legegyszerűbb állatok egyikének neurológiájának és élettanának szimulálásával. Olvass tovább ). Más szavakkal: az AIXI bármely emberi lényt képes túlmutatni bármely intellektuális feladatnál (elegendő számítási teljesítmény mellett), de Lehet, hogy nem ismeri a győzelmét Gondolkodógépek: Mit taníthat nekünk az idegtudomány és a mesterséges intelligencia a tudatosságrólMegtaníthat-e mesterségesen intelligens gépeket és szoftvereket a tudat működésére és az emberi elme természetére? Olvass tovább .

Mint gyakorlati AI, az AIXI sok problémával rendelkezik. Először is, nincs mód arra, hogy megtalálja azokat a programokat, amelyek előállítják az érdeklődését. Ez egy brute-force algoritmus, ami azt jelenti, hogy nem praktikus, ha nem történik egy önkényesen hatalmas számítógép fekszik. Az AIXI tényleges megvalósítása szükségszerűen közelítés, és (manapság) általában meglehetősen durva. Ennek ellenére az AIXI elméleti pillantást ad nekünk arra, hogy hogyan néz ki egy hatalmas mesterséges intelligencia, és hogy ez miért magyarázható.

Az értékek tere

Ha megtettél bármilyen számítógépes programozást A számítógépes programozás alapjai 101 - Változók és adattípusokBemutattuk és kicsit beszéltünk az objektum-orientált programozásról korábban és hol a neve származik, azt hittem, itt az ideje, hogy átlépjük a programozás abszolút alapjait egy nem nyelv specifikusan út. Ez... Olvass tovább , tudod, hogy a számítógépek zavaróan, pedantikusan és mechanikailag literálisak. A gép nem tudja, hogy érdekli, mit akar csinálni: csak azt teszi, amit mondtak. Ez egy fontos fogalom, amikor a gépi intelligenciáról beszélünk.

Ezt szem előtt tartva képzelje el, hogy kitalált egy hatalmas mesterséges intelligenciát - jöttél fel okos algoritmusokkal az Ön adataival megegyező hipotézisek előállításához és a megfelelő jelölt előállításához terveket. AI képes megoldani az általános problémákat, és hatékonyan meg tudja csinálni a modern számítógépes hardverekkel.

Itt az ideje, hogy válasszon egy segédfunkciót, amely meghatározza az AI értékeit. Mit kérsz tőle, hogy értékelje? Ne felejtse el, hogy a gép zavaróan, pedantszerűen lesz szó arról, hogy melyik funkciót használja fel, hogy maximalizálja, és soha nem fog megállni - nincs szellem a a gép, amely valaha „felébred” és úgy dönt, hogy megváltoztatja a közmű funkcióját, függetlenül attól, hogy hány hatékonyságjavulást fejlesztett be a sajátjához érvelés.

Eliezer Yudkowsky tedd így:

Mint minden számítógépes programozásnál, az AGI alapvető kihívása és alapvető nehézsége az, hogy ha rossz kódot írunk, az AI nem fogja automatikusan átnézni a kódot, megjelölni a hibákat, kitalálni, mit valójában akartunk mondani, és megteszi helyette. A nem programozók néha elképzelik az AGI-t vagy általában a számítógépes programokat, mint amelyek hasonlóak azokhoz a szolgákhoz, akik kétségtelenül követik a parancsokat. De nem az, hogy az AI abszolút engedelmes a kódjához; inkább az AI egyszerűen jelentése a kód.

Ha egy gyárat próbál működtetni, és azt mondja a gépnek, hogy értékeli a gémkapcsok készítését, majd átadja a gyár robotjainak csomóinak irányítását, akkor Ön másnap visszatérhet, hogy kiderül, hogy minden más alapanyagból kifogyott, megölte az összes alkalmazottat, és gémkapcsokat készített maradványok. Ha megpróbálja kijavítani a tévedését, akkor átprogramozza a gépet, hogy egyszerűen mindenkit boldoggá tegyen, másnap visszatérhet, hogy vezetékeket vezet az emberek agyába.

A lényeg itt az, hogy az embereknek nagyon sok bonyolult értéke van, amelyeket feltételezzük, hogy implicit módon megosztják más elmékkel. Nagyra értékeljük a pénzt, de jobban értékelik az emberi életet. Boldog akarunk lenni, de nem feltétlenül akarunk vezetékeket az agyunkba tenni. Nem érezzük, hogy tisztáznunk kell ezeket a dolgokat, amikor utasításokat adunk más embereknek. Ugyanakkor nem tehet ilyen feltevéseket, amikor egy gép segédfunkcióját tervezi. Az egyszerű segédfunkció lélektelen matematikája során a legjobb megoldások gyakran azok a megoldások, amelyeket az emberek kedvelik az erkölcsi szörnyűség miatt.

Ha egy intelligens gép lehetővé teszi a naiv segédfunkció maximalizálását, szinte mindig katasztrofális. Amint az Oxford filozófus, Nick Bostom mondja,

Nem szabad azt feltételezni, hogy a szuperintelligencia szükségszerűen megosztja a bölcsességgel sztereotípiásán társított végső értékeket. és az emberek szellemi fejlődése - tudományos kíváncsiság, mások iránti jóindulatú érdeklődés, szellemi megvilágosodás és szemlélődés, az anyagi megismerhetőségről, a kifinomult kultúra vagy az élet egyszerű élvezeteinek, az alázat és az önzetlenség ízének lemondása, és így tovább.

A helyzet még rosszabbá tétele nagyon, nagyon nehéz meghatározni az emberek által értékelt mindent tartalmazó teljes és részletes listáját. A kérdésnek sok szempontja van, és akár egyetlen kérdés elfelejtése is katasztrofális. Még azok között is, akiknek tisztában vagyunk, vannak olyan finomságok és összetettségek, amelyek megnehezítik, hogy tiszta egyenletrendszerként írják le azokat, amelyeket egy géphez adhatunk, mint hasznos funkciót.

Néhányan ezt elolvasva arra a következtetésre jutnak, hogy az AI-k segédfunkciókkal való építése szörnyű ötlet, és csak különféleképpen kellene őket megterveznünk. Itt is vannak rossz hír - ezt hivatalosan is bizonyíthatja bármely olyan ügynöknek, amelynek nincs valamilyen segédfunkcióval egyenértékű tulajdonsága, nem lehet koherens preferenciáinak a jövőről.

Rekurzív önfejlesztés

A fenti dilemmának egyik megoldása az, hogy ne biztosítsák az AI ügynököinek az embereket bántani: csak azokat az erőforrásokat kell adni nekik, oldja meg a problémát úgy, ahogyan azt szándékozik megoldani, szorosan felügyelje őket, és tartsa távol a nagyszerű lehetőségeketől sérelem. Sajnos az intelligens gépek irányításának képessége nagyon gyanús.

Még akkor is, ha nem sokkal okosabbak, mint mi vagyunk, fennáll annak a lehetősége, hogy a gép „elindul” - jobb hardvert gyűjtsön vagy javítson saját kódjában, ami még intelligensebbé teszi. Ez lehetővé tenné, hogy egy gép sok nagyságrenddel átugorja az emberi intelligenciát, és ugyanolyan értelemben túlélte az embereket, mint az emberek, mint a macskák. Ezt a forgatókönyvet először egy I. nevű ember javasolta. J. Jó, aki az Enigma kriptoanalízis-projekten dolgozott Alan Turing mellett a második világháború alatt. „Intelligencia robbanásnak” nevezte, és így írta le az ügyet:

Legyen egy rendkívül intelligens gép olyan gép, amely meghatározhatja bármely ember szellemi tevékenységeit, bármennyire okos is. Mivel a gépek tervezése a szellemi tevékenységek egyike, az ultra intelligens gépek még jobb gépeket is megtervezhetnek; akkor vitathatatlanul lenne „intelligencia-robbanás”, és az ember intelligenciája messze maradna. Így az első rendkívül intelligens gép az utolsó találmány, amelyet az embernek valaha készítenie kell, feltéve, hogy a gép elég tanuló.

Nem garantált, hogy egy intelligencia robbanás lehetséges univerzumunkban, de valószínűnek tűnik. Az idő múlásával a számítógépek gyorsabbak, és alapvető betekintést nyernek az intelligencia terén. Ez azt jelenti, hogy az utolsó és egy általános, lendületes intelligenciára való áttéréshez az erőforrás-igény egyre alacsonyabb lesz. Egy bizonyos ponton olyan világban találjuk meg magunkat, ahol emberek milliói vezethetnek a Best Buy-ra, és felvehetik a hardvert és műszaki irodalom, amelyre szükségük van egy önjavító mesterséges intelligencia felépítéséhez, amelyet már létrehozhattunk veszélyes. Képzelj el egy olyan világot, ahol atombombákat készíthet botokból és sziklákból. Ez a fajta jövő, amelyet megbeszélünk.

És ha egy gép végrehajtja ezt az ugrást, akkor az intellektuális szempontból nagyon gyorsan túllépheti az emberi fajt termelékenység, olyan problémák megoldása, amelyeket egy milliárd ember nem képes megoldani, ugyanúgy, mint az emberek olyan problémákat oldhatnak meg, amelyek a milliárd macska nem tudja.

Fejleszthet nagy teljesítményű robotokat (vagy bio- vagy nanotechnológiát), és viszonylag gyorsan megszerezheti azt a képességét, hogy alakítsák a világot tetszés szerint, és nagyon kevés lenne, amit tehetnénk. Egy ilyen intelligencia nagy problémák nélkül megfoszthatja a Földet és a Naprendszer többi részét alkatrészektől, és mindent megtehet, amit mondtunk. Valószínűnek tűnik, hogy egy ilyen fejlemény katasztrofális lenne az emberiség számára. A mesterséges intelligencianek nem kell rosszindulatúnak lennie a világ elpusztításához, pusztán katasztrofálisan közömbösnek.

Ahogy a mondás szól: "A gép nem szeret és nem utál téged, de atomokból készül, amelyeket más célokra felhasználhat."

Kockázatbecslés és -csökkentés

Tehát, ha elfogadjuk, hogy egy olyan hatalmas mesterséges intelligencia megtervezése, amely maximalizálja az egyszerű segédfunkciót, rossz, akkor mennyi bajban vagyunk valójában? Mennyi időnk van ahhoz, hogy lehetővé váljunk ilyen típusú gépek gyártása? Természetesen nehéz megmondani.

Mesterséges intelligencia fejlesztők haladás. 7 csodálatos webhely, hogy megnézhesse a legújabb mesterséges intelligencia programozástA mesterséges intelligencia még nem HAL a 2001-es évekből: The Space Odyssey... de félelmetesen közeledünk. Valóban, egy nap hasonló lehet ahhoz a sci-fi kazánhoz, amelyet Hollywood kiolt. Olvass tovább Az általunk gyártott gépek és a megoldandó problémák köre folyamatosan növekszik. 1997-ben a Deep Blue sakkot tudott magasabb szinten játszani, mint egy emberi nagymester. 2011-ben az IBM Watson elegendő információt tudott olvasni és szintetizálni, annyira mélyen és gyorsan, hogy legyőzze a legjobb embert játékosok egy nyitott kérdések és válaszok játékában, pontokkal és szójátékokkal tele - ez tizennégy évben nagy előrelépés évek.

Jelenleg a Google az komoly beruházások a mély tanulás kutatásába, egy olyan módszer, amely lehetővé teszi az erősebb idegi hálózatok felépítését egyszerűbb idegi hálózatok láncának felépítésével. Ez a beruházás lehetővé teszi számára, hogy komoly haladást érjen el a beszéd és a képfelismerés terén. Legutóbbi akvizíciójuk a DeepMind nevű Deep Learning induló vállalkozás, amelyért mintegy 400 millió dollárt fizettek. Az üzlet feltételeinek részeként a Google beleegyezett egy etikai testület felállításába annak biztosítása érdekében, hogy AI-technológiájukat biztonságosan fejlesszék.

Ugyanakkor az IBM fejleszti a Watson 2.0 és 3.0 rendszereket, amelyek képeket és videókat tudnak feldolgozni és a következtetések megvédésére hivatkoznak. Egy egyszerű, korai bemutatót adtak a Watson azon képességéről, hogy az alábbi videó bemutatóban szintetizáljon érveket egy téma mellett és ellen. Az eredmények nem tökéletesek, de lenyűgöző lépés függetlenül attól.

Ezen technológiák egyike ma sem veszélyes manapság: a mesterséges intelligencia mint mező továbbra is küzd ahhoz, hogy megfeleljen a kisgyermekek által elsajátított képességeknek. A számítógépes programozás és az AI tervezése nagyon nehéz, magas szintű kognitív képesség, és valószínűleg ez lesz az utolsó emberi feladat, amelyen a gépek jártasak lesznek. Mielőtt odajutunk erre a pontra, rendelkezésére állnak mindenütt jelen lévő gépek ami képes vezetni Így juthatunk el a sofőr nélküli autókkal teli világhozA vezetés unalmas, veszélyes és igényes feladat. Lehet-e egy nap automatizálni a Google sofőr nélküli autós technológiája? Olvass tovább , gyakorolni az orvostudományt és a jogot, és valószínűleg más is, mély gazdasági következményekkel jár.

Az az idő, amellyel eljuthatunk az önfejlesztés inflációs pontjához, az attól függ, hogy milyen gyorsan vannak jó ötletek. Az ilyen technológiai fejlődés előrejelzése rendkívül nehéz. Nem tűnik indokolatlannak, hogy húsz év múlva képesek leszünk erős AI-t építeni, de nem tűnik ésszerűtlennek is, ha ez nyolcvan évig tarthat. Akárhogy is, akkor végül megtörténik, és okkal feltételezhetjük, hogy amikor ez megtörténik, rendkívül veszélyes lesz.

Tehát, ha elfogadjuk, hogy ez problémát jelent, akkor mit tehetünk vele? A válasz az, hogy megbizonyosodjunk arról, hogy az első intelligens gépek biztonságosak-e, és így jelentős intelligenciaszintre képesnek indulni, majd megvédhetnek minket a később gyártott nem biztonságos gépektől. Ezt a „biztonságot” az emberi értékek megosztása és az emberiség védelmére és segítségére való hajlandóság határozza meg.

Mivel valójában nem tudunk leülni és programozni az emberi értékeket a gépbe, valószínűleg meg kell tervezni egy olyan segédfunkciót, amely megköveteli a géptől figyelje meg az embereket, vonja le az értékeinket, majd próbálja azokat maximalizálni. A fejlesztés ezen folyamatának biztonságossá tétele érdekében hasznos lehet a kifejezetten megtervezett mesterséges intelligencia fejlesztése is nem preferenciák bevezetése a közüzemi funkciókkal kapcsolatban, lehetővé téve számukra, hogy javítsuk vagy ellenállás nélkül kapcsoljuk ki azokat, ha a fejlesztés során elkezdenek eltévedni.

Számos olyan probléma, amelyet meg kell oldanunk a biztonságos gépi intelligencia felépítéséhez, matematikai szempontból nehéz, de okkal feltételezhetjük, hogy megoldhatók is. Számos különböző szervezet dolgozik a kérdéssel, köztük a Az Oxfordi Humanity Institute jövője, és a Gépi intelligencia Kutatóintézet (amelyet Peter Thiel finanszíroz).

A MIRI kifejezetten érdekli a barátságos intelligencia kialakításához szükséges matematika fejlesztését. Ha kiderül, hogy a mesterséges intelligencia elindítása lehetséges, akkor ezt kell kifejleszteni Először, ha a „barátságos AI” technológia sikeres, akkor az a legfontosabb dolog, amely az embereknek van valaha is csináltam.

Gondolod, hogy a mesterséges intelligencia veszélyes? Aggódik amiatt, hogy az AI jövője mit hozhat? Ossza meg gondolatait az alábbi megjegyzés szakaszban!

Kép-hitelek: Lwp Kommunikáció Via Flickr, “Neurális hálózat„, Az fdecomite által” img_7801“, Előterjesztette Steve Rainwater,„ E-Volve ”, Keoni Cabral,„new_20xRobert Cudmore írta:GémkapocsClifford Wallace

A délnyugati székhelyű író és újságíró garantáltan 50 Celsius-fokig képes működni, és tizenkét láb mélységig vízálló.